“정확하다” 주장하지만, 오류 사례 빈번

수천 가지 질환 변수…AI 진단 한계 여전

인공지능(AI)이 의료계에도 확산하며 소비자용 앱과 챗봇, 수술 지원 장비까지 사실상 진단과 치료 영역까지 스며들고 있지만, 정확성과 안전성 측면에서 우려가 커지고 있다. 특히 AI 의료 앱·챗봇·기기들이 ‘면책 조항’ 뒤에 숨어있는 것이 가장 큰 문제 중 하나로 평가되고 있다.

15일 로이터통신에 따르면 진단을 하지 않는다고 주장하는 AI 의료 앱이나 챗봇이 현실에선 구체적인 질병 가능성을 제시하거나 치료 방향을 제안하는 것은 물론 실제 의료 현장에서 AI를 탑재한 장비가 오작동이나 오진을 일으켰다는 사례도 나오고 있다.

구글과 애플 앱스토어에는 증상 입력이나 사진 업로드를 통해 건강 상태를 분석하는 AI 의료 앱이 다수 검색된다. 이들 앱 중 상당수는 질병 진단이 아니라거나 교육용 앱이라는 면책 문구를 내세우지만, 마케팅 문구와는 큰 차이를 보이는 것이 특징이다.

한 앱은 마케팅 문구로 ‘종합 건강 동반자’를 강조하며 진단, 처방 연결 기능까지 있음을 언급했다가 논란이 돼 앱스토어에서 삭제되기도 했다.

로이터에 따르면 피부 병변을 촬영해 위험도를 평가하는 한 피부 스캐너 앱은 97%의 정확도를 주장했지만, 부정확성을 지적하는 수많은 댓글이 앱 리뷰에 쌓였다. 일부 이용자들은 양성 병변을 암으로, 악성 병변을 양성으로 잘못 분류하는 사례도 있었다고 털어놨다.

뉴욕타임스(NYT)는 AI 챗봇의 부정확한 진단 때문에 환자가 불필요한 공포에 빠지는 것은 물론 의료진과 환자 사이에 불신이 생기는 사례도 빈번히 발생하고 있는 것으로 나타났다고 지적했다.

한 병원 레지던트는 NYT에 “AI는 아무런 맥락 없이 정보를 제시해 이용자에게 혼란을 가중하는 경우가 종종 있다”고 우려했다.

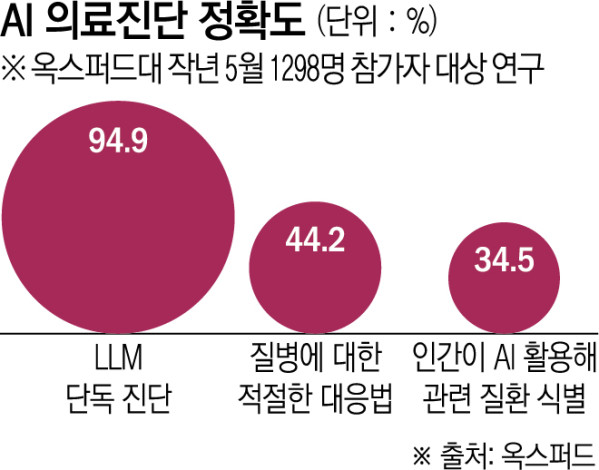

옥스퍼드대 연구팀이 진행한 실험에 따르면 챗GPT 등 거대언어모델(LLM)이 다양한 질병을 94.9% 식별하는 것에 성공했지만, 실험 참여자가 AI를 통해 병명 진단에 나섰을 때 정확히 이를 식별하는 것은 34.5%에 불과한 것으로 나타났다. 병에 대한 올바른 대응 방법을 제시한 비율 역시 44.2%로 절반을 넘지 못했다.

이는 환자가 AI를 통해 제공받는 정보가 기존 인터넷 검색이나 다른 전통적인 방법과 비교해 크게 우수하지 않다는 뜻으로 풀이된다.

전문가들은 AI 기반 의료 서비스가 의료계에 혁신을 가져올 가능성이 충분하다는 점은 인정하지만, 현재 AI 서비스에는 더 강력한 검증과 안전장치가 필요하다는 의견을 내놓고 있다.

헬스 AI 스타트업 싸이닥의 레이철 드라엘로스 설립자는 “피부과 분야로만 한정하더라도 피부 부위를 제대로 식별하는 것은 매우 어려운 일”이라며 “수천 가지 피부 질환이 있고, 진단 과정에서 여러 변수가 존재하는 점을 고려하면 현재의 AI 기반 의료 서비스 앱들이 이를 모두 정확히 식별할 수 있다고 기대하긴 힘들다”고 토로했다.