'금융분야 AI 가이드라인'과 함께 1분기 중 시행 예정

금융당국이 금융권 인공지능(AI) 활용 확산에 대응해 금융회사가 참고할 수 있는 '금융분야 AI 위험관리 프레임워크'를 제시한다. 금융권 의견수렴을 거쳐 ‘금융분야 AI 가이드라인’과 함께 올해 1분기 중 시행할 예정이다.

금융감독원은 16일 금융회사의 AI 활용 전 주기에 걸친 위험관리 기준을 담은 ‘금융분야 AI 위험관리 프레임워크(AI RMF)’를 도입한다고 밝혔다. AI RMF는 금융회사의 AI 관련 거버넌스·위험평가·위험통제 핵심 프로세스를 제시하는 가이드라인 형태의 자발적 지침으로, 각 회사 사정에 따라 강화·완화 또는 선택 적용이 가능하다.

AI RMF는 ‘금융분야 AI 가이드라인’에 포함된 금융 AI 7대 원칙 가운데 ‘거버넌스 원칙’을 구체화한 것이다. 금융당국은 금융권이 AI 대전환을 선도할 수 있도록 망분리 규제 합리화, 인프라·데이터 제공 등을 통해 지원해왔고 2021년 운영 가이드라인, 2022년 개발·활용 안내서, 2023년 보안 가이드라인 등 다양한 형태의 가이드라인을 제공해왔다.

금감원에 따르면 지난해 4월말 기준 국내 금융업권에서는 총 118개 회사가 653개의 AI 서비스를 준비 중이거나 활용 중이다. 업권별로는 은행 20개사가 299개, 증권 37개사가 143개, 보험 53개사가 145개, 카드 8개사가 66개의 AI 서비스를 운영하거나 준비하고 있다. 회사별 평균 AI 서비스 수는 은행이 15.0개로 가장 많았고 카드 8.3개, 증권 3.9개, 보험 2.7개 순이다.

그러나 금융 AI 위험의 차별적 특성과 파급력에도 불구하고 거버넌스 및 위험관리는 대체로 미진한 상황이다. 금감원이 국내 금융회사를 전수 점검한 결과 총 118개 금융사 가운데 은행 5개(25%), 보험사 4개(7.5%), 증권사 1개(2.7%)만 의사결정기구를 설치했다. 약 85%의 금융사는 AI 윤리원칙, 위험관리 기준 등이 마련돼 있지 않았다. 감독당국이 제시한 AI 관련 가이드라인을 적용한 비율도 약 60%로 저조했다.

이에 상당수 금융사는 AI 거버넌스 및 위험관리 불확실성 해소와 책임소재 명확화를 위해 금융권 특수성을 반영한 가이드라인 제시를 희망한 것으로 나타났다.

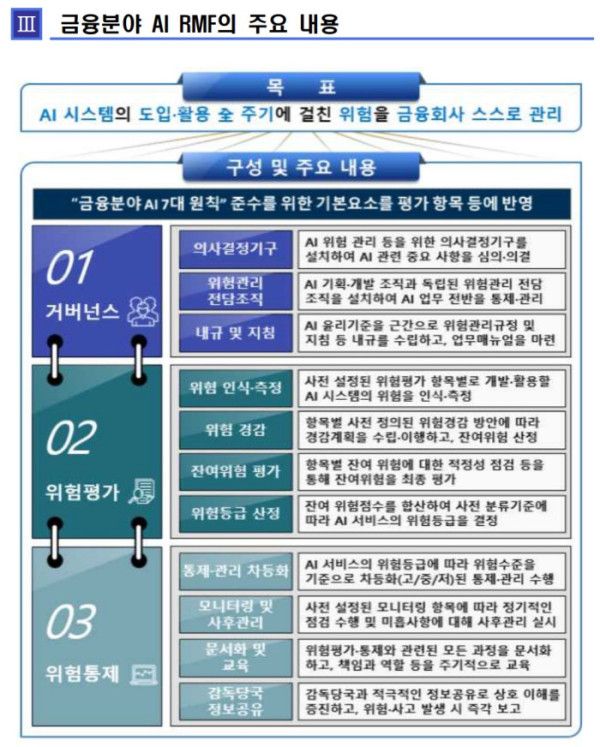

AI RMF는 크게 △AI 거버넌스 △AI 위험평가 △AI 위험통제 3단계로 구성된다. 우선 ‘AI 거버넌스’에서는 금융회사가 AI 위험관리 등을 위한 의사결정기구와 전담조직을 구성하고 관련 내규를 마련하도록 했다. 명확한 책임소재를 바탕으로 ‘견제와 균형’ 하에 AI 시스템의 기획·구축·운영 전 단계에 걸친 잠재적 위험을 평가·관리하도록 유도하는 구조다.

의사결정기구는 AI 윤리위원회, AI 위험관리위원회 등을 예시로 들었다. AI 윤리원칙 등 AI 관련 내규 제·개정, 위험관리·소비자보호정책 수립, 고위험 AI 서비스 승인 등 AI 관련 중요사항을 심의·의결하는 역할을 맡는다. 특히 위원장은 CEO가 AI와 관련된 사업계획, 전략, 위험 등을 명확히 인식할 수 있도록 CEO에게 정기적으로 보고하도록 했다. 책무구조도를 도입한 금융회사는 AI 관련 내부통제 및 위험관리 책무를 반영해 AI 도입·활용에 따른 책임소재를 명확화하는 방안도 고려할 수 있다.

위험관리 전담조직은 AI 도입·개발 추진 조직과 독립된 형태로 두도록 제시했다. AI 위험의 인식·측정·평가 등 위험관리 전반을 통할하고 ‘AI 기본법’ 등 관련 법규상 각종 의무의 준수 여부를 관리·감독하는 기능을 맡는다. 이해상충 방지를 위한 독립성 확보 방안을 수립할 필요가 있다는 점도 명시했다.

내규 측면에서는 AI 윤리기준을 근간으로 AI 위험관리규정 및 지침 등 AI 관련 내규를 수립하고 세부 업무매뉴얼을 마련하도록 했다. 특히 금융 및 AI 관련 법규 준수 의무를 부과하고 최종 의사결정 책임을 임직원이 지도록 내규화하는 방향을 제시했다. 표준화된 매뉴얼로 AI 도입·활용 전 프로세스를 관리하고 부서 간 역할과 책임을 명확화해 잠재 위험에 대응한다는 구상이다.

‘AI 위험평가’에서는 위험기반 접근방법(Risk-based approach)의 종합 평가체계를 구성하도록 했다. 다만 규칙 기반 접근방법(Rule-based approach) 등 금융회사의 AI 도입 범위, 규모, 인력 등 자체 실정에 맞는 위험등급 분류도 허용했다. 위험평가 체계는 금융 AI 7대 원칙 가운데 정량적 요소인 합법성·신뢰성·신의성실·보안성을 토대로 설계하고 원칙 준수를 위한 기본요소를 평가 항목에 반영하도록 했다. 위험 인식·측정→위험 경감→잔여위험 평가→위험등급 산정의 절차를 통해 AI 서비스별 위험을 분류한다.

또 법체계와 정합성 확보를 위해 AI 기본법상 '고영향 AI'에 대해서는 위험점수에 따른 등급 분류와 관계없이 고위험 서비스로 분류하도록 했다. AI 기본법은 고영향 AI의 예시로 ‘대출 심사 등 개인의 권리·의무 관계에 중대한 영향을 미치는 판단 또는 평가’를 포함했다.

‘AI 위험통제’에서는 위험 수준별로 차등화된 통제·관리를 수행하도록 했다. 위험평가를 통해 산출한 AI 서비스 위험등급을 기준으로 승인절차와 문서 작성, 사전 경감조치 검증, 운영단계 모니터링과 보고, 위험 변경 시 재평가, 업무매뉴얼·검증매뉴얼 등 세부 방법에 따른 관리를 단계적으로 적용한다. 고위험 서비스에는 AI 윤리위원회 사전 승인과 사후 검증, 제3자 평가검증, 운영 단계 모니터링 강화 등을 예시로 들었다.

초고위험 AI 시스템에 대해서는 AI 의사결정기구를 통해 출시 여부를 재검토하도록 했다. 금융안정성 훼손 또는 소비자 권익 침해 우려가 있다고 의사결정기구가 판단하는 경우 등이 해당한다. 이와 함께 모니터링·사후관리, 문서화 및 교육, 감독당국 정보공유 등 위험통제를 위한 제반 내부통제 절차 이행도 포함했다.

금감원은 업권별 협회 등을 통해 AI RMF(안)을 금융권에 배포하고 설명회·간담회 등을 통해 의견수렴을 거친 뒤 1분기 중 최종안을 확정·시행할 예정이다. 금감원은 "모범사례 전파와 도입회사 실태점검 등을 통해 AI RMF의 거버넌스·위험관리·위험통제 프로세스가 금융회사 내부통제 체계에 안착할 수 있도록 지원하겠다"고 밝혔다.