안전성 관련 공통 규범 확립해야

▲일론 머스크 테슬라 최고경영자(CEO)가 미국 캘리포니아 로스앤젤레스에서 발언하고 있다. 로스엔젤레스/로이터연합뉴스

29일(현지시간) 로이터통신에 따르면 미국 비영리단체 ‘삶의 미래 연구소(FLI)’는 이러한 내용이 담긴 서한을 1000여 명이 넘는 유명인사들의 서명을 받아 공개했다.

여기에는 머스크 CEO와 스티브 워즈니악 애플 공동 창업자, 에마드 모스타크 스테빌리티AI CEO, 에번 샤프 핀터레스트 CEO, 세계적 AI 권위자인 요슈아 벤지오 몬트리올대 교수와 스튜어트 러셀 UC버클리 교수, 글로벌 베스트셀러 작가 유발 하라리 등이 이름을 올렸다.

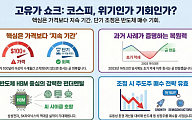

이들은 오픈AI의 ‘GHP-4’를 뛰어넘는 AI 시스템의 개발과 훈련을 반 년간 중단하자고 주장했다. 첨단 AI 개발의 안전성에 관한 공통 규범을 책정, 실행, 검증할 때까지 브레이크를 밟자는 것이다.

이들은 서한에서 “지난 몇 달 동안 AI 연구소는 개발자조차도 이해하고 예측하고 안정적으로 제어할 수 없는 더 강력한 디지털 뇌를 개발하기 위해 통제 불가능한 경쟁에 매진하고 있다”고 지적했다.

이어 인간과 경쟁하는 AI 시스템이 경제적·정치적 혼란을 통해 사회와 문명에 초래할 수 있는 위험에 관해 설명했다. 그러면서 “강력한 AI 시스템은 긍정적 효과가 있고 위험 관리가 가능하다고 확신할 수 있는 경우에만 개발돼야 한다”며 개발자들에게 규제 당국과 협력할 것을 촉구했다.