KAIST(한국과학기술원)는 기계공학과 박용화 교수 연구팀이 ㈜에스엠 인스트루먼트와 공동으로 실시간으로 기침 소리를 인식하고 기침하는 사람의 위치를 이미지로 표시해주는 '기침 인식 카메라'를 개발했다고 3일 밝혔다.

코로나19의 대표적인 증상이 발열과 기침인데, 현재 발열은 열화상 카메라를 이용해 직접 접촉을 하지 않고도 체온을 쉽게 판별할 수 있다. 문제는 비접촉방식으로는 기침하는 사람의 증상을 쉽사리 파악하기 어렵다는 점이다. 박 교수 연구팀은 이런 문제를 해결하기 위해 기침 소리를 실시간으로 인식하는 딥러닝 기반의 기침 인식 모델을 개발했다.

연구팀은 열화상 카메라와 같은 원리로 기침 소리와 기침하는 사람의 시각화를 위해 기침 인식 모델을 음향 카메라에 적용, 기침 소리와 기침하는 사람의 위치, 심지어 기침 횟수까지를 실시간으로 추적하고 기록이 가능한 기침 인식 카메라를 개발했다.

연구팀은 기침 인식 카메라가 사람이 밀집한 공공장소에서 전염병의 유행을 감지하거나 병원에서 환자의 상태를 상시 모니터링 가능한 의료용 장비로 활용될 것으로 기대하고 있다.

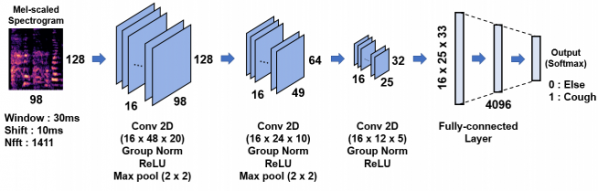

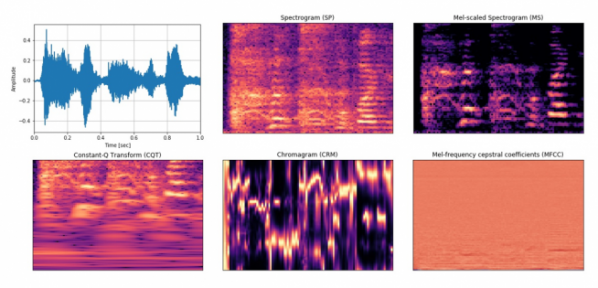

연구진은 기침 인식 모델 개발을 위해 합성 곱 신경망(CNN)을 기반으로 지도학습을 적용했다. 1초 길이 음향신호의 특징을 입력 신호로 받아 1(기침) 또는 0(그 외)의 2진 신호를 출력하고 학습률의 최적화를 위해 일정 기간 학습률이 정체되면 학습률 값을 낮추도록 설정했다.

연구진은 기침 인식 모델의 훈련 및 평가를 위해 구글과 유튜브 등에서 연구용으로 활발히 사용 중인 공개 음성데이터 세트인 '오디오세트'를 비롯해 디맨드(DEMAND)와 이티에스아이(ETSI), 티미트(TIMIT) 등에서 데이터 세트를 수집했다. 이 중 오디오세트는 훈련 및 평가 데이터 세트 구성을 위해 사용했고, 다른 데이터 세트의 경우 기침 인식 모델이 다양한 배경 소음을 학습할 수 있도록 데이터 증강을 위한 배경 소음으로 사용했다.

데이터 증강을 위해 배경 소음을 15%~75%의 비율로 오디오세트에 섞은 후 다양한 거리에 적응할 수 있게 음량을 0.25~1.0배로 조정했다. 훈련 및 평가 데이터 세트는 증강된 데이터 세트를 9대1 비율로 나눠 구성했으며, 시험 데이터 세트는 따로 사무실에서 녹음한 것을 사용했다.

연구진은 이어 학습된 기침 인식 모델을 소리를 수집하는 마이크로폰 어레이와 카메라 모듈로 구성되는 음향 카메라에 적용했다. 그 결과 수집된 데이터는 음원의 위치를 계산하는 빔 형성 과정을 거쳐 기침 인식 모델이 기침 소리로 인식할 경우 기침 소리가 난 위치에 기침 소리임을 나타내는 등고선과 라벨이 각각 표시된다. 연구팀은 추후 병원 등 실사용 환경에서 추가 학습이 이뤄진다면 정확도는 87.4%보다 더 높아질 것으로 기대하고 있다.

박용화 교수는 "코로나19가 지속적으로 전파되고 있는 상황에서 공공장소와 다수 밀집 시설에 기침 인식 카메라를 활용하면 전염병의 방역 및 조기 감지에 큰 도움이 될 것"이라며 "병실에 적용하면 환자의 상태를 24시간 기록해 치료에 활용할 수 있기 때문에 의료진 수고를 줄이고 환자 상태를 더 정밀하게 파악할 수 있다"고 설명했다. 이번 연구는 에너지기술평가원(산업통상자원부)의 지원을 받아 수행됐다.